Gary Marcus, nhà nghiên cứu AI và cũng là người hay phê bình xu hướng thổi phồng khả năng của AI, nhận xét rằng bản thân các mô hình ngôn ngữ thì về cơ bản vẫn thiếu tin cậy như trước. Nhưng đặc biệt trong các lĩnh vực như toán học và lập trình, người ta có thể chuyển đầu ra của LLM sang các công nghệ khác, những thứ từng bị xem là lỗi thời nhưng thực ra rất hữu ích. Ông cũng khen ngợi các hệ thống như Claude Code vì khả năng kết hợp LLM với thế giới toán học cứng nhắc, chính xác của code máy tính.

Chính ở đây, mã nguồn bị rò rỉ của Claude Code trở nên thú vị. Bên trong là một hệ thống quản lý bộ nhớ ngữ cảnh tinh vi, giúp các cuộc hội thoại dài không bị “ngộp” thông tin, vì ngữ cảnh quá dài là một trong những nguyên nhân chính làm tăng tỷ lệ bịa đặt và giảm hiệu quả của các cơ chế an toàn. Đây là sự kết hợp kiểu rất con người, bộ não sáng tạo và linh hoạt đặt cạnh chiếc máy tính bỏ túi đáng tin cậy.

Lý do 3: AI tự kiểm tra kết quả của mình, và kiểm tra lẫn nhau

Trong giai đoạn đầu, các chatbot trả lời câu hỏi gần như ngay lập tức, xuất chữ liên tục mà không có bước dừng lại để suy nghĩ. Ngày nay, với hầu hết các câu hỏi không đơn giản, AI sẽ thực hiện một bước gọi là chuỗi suy nghĩ: hệ thống sẽ tự “trò chuyện với chính mình” để kiểm tra lập luận trước khi đưa ra câu trả lời cuối cùng. Bước nội suy này giúp phát hiện nhiều lỗi trước khi chúng đến tay người dùng.

LLM Council

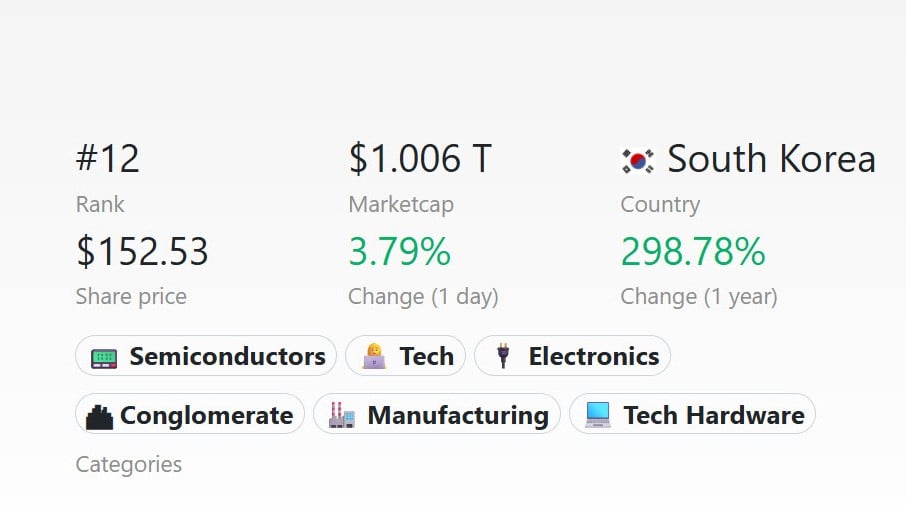

Một số hệ thống còn đi xa hơn: chúng dùng một mô hình AI khác, thường là biến thể của chính mình, để kiểm tra lại đáp án. Điều này không chỉ dừng lại trong phạm vi một công ty nữa. Khi các doanh nghiệp xây dựng hệ thống AI cho nhu cầu nội bộ, họ có thể cấu hình để kết quả từ một nhà cung cấp AI này được kiểm tra chéo bởi mô hình từ nhà cung cấp khác hoàn toàn, chẳng hạn Claude kiểm tra kết quả của ChatGPT, hoặc ngược lại. Kết quả chỉ được chấp nhận khi cả hai mô hình đồng ý với nhau.

Pavel Kirillov, Giám đốc Công nghệ của NineTwoThree, một công ty tư vấn xây dựng hệ thống AI cho các khách hàng như FanDuel và Consumer Reports, gọi cách tiếp cận này là “council of models”, lược dịch: hội đồng mô hình. Theo ông, kết quả thu được có chất lượng tốt hơn rõ rệt, với tỷ lệ lỗi thấp hơn so với khi chỉ dùng một mô hình duy nhất.

Điểm mấu chốt

Các mô hình AI cốt lõi ngày nay thông minh hơn so với vài năm trước, nhưng lý do chính khiến các dịch vụ AI trở nên hữu ích hơn rõ rệt là vì chúng được trang bị thông tin cập nhật hơn, biết dùng công cụ phù hợp, và có cơ chế tự kiểm soát lẫn nhau. Đây không phải là lý trí kiểu con người, mà là thứ thực dụng hơn nhiều: những nhà phát triển AI nhận ra rằng các hệ thống của họ không thể làm tốt mọi thứ một mình, và bắt đầu trang bị cho chúng những công cụ mà loài người đã mất hàng nghìn năm để tạo ra.

Vụ rò rỉ mã nguồn Claude Code không phải là một thảm họa bảo mật theo nghĩa thông thường, nhưng nó là một lời nhắc nhở thú vị rằng AI hiện đại không phải là phép màu. Đằng sau giao diện chat đơn giản là cả một hệ thống kỹ thuật phức tạp, được xây dựng công phu để bù đắp cho những giới hạn vốn có của mô hình ngôn ngữ. Và chính lớp kỹ thuật đó mới là thứ đang thay đổi nhanh nhất.

Nguồn: [1][2][3][4]

công nghệ, khoa học, kĩ thuật, mẹo vặt, cộng đồng, thảo luận, hỏi đáp, sửa lỗi, máy tính, sự cố, camera, lỗi điện thoại, lỗi máy tính#lý #khiến #ngày #nay #đáng #tin #cậy #hơn #trước #đây1777007050