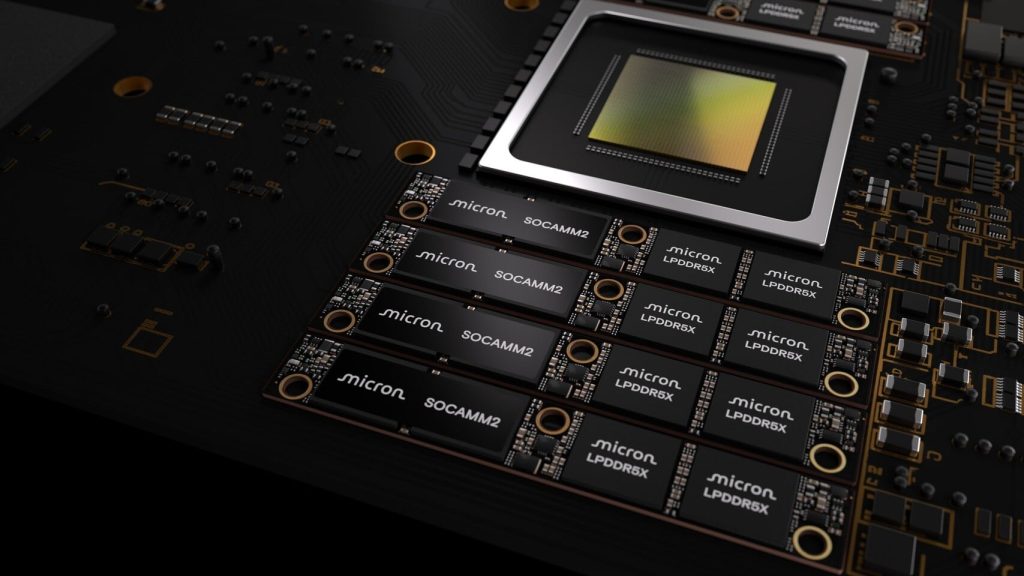

Micron cho biết họ sử dụng thiết kế module LPDDR5X 32 Gb dạng monolithic, qua đó mở đường cho các cấu hình bộ nhớ công suất thấp nhưng dung lượng lớn, phục vụ các máy chủ mới trong bối cảnh AI training, inference, agentic AI và tác vụ tính toán phổ thông đang đồng thời làm phình nhu cầu bộ nhớ.

Theo Micron, các mô hình AI hiện đại ngày càng đòi hỏi cửa sổ ngữ cảnh lớn, tham số mô hình nặng hơn và đặc biệt là KV cache, khiến dung lượng, hiệu quả băng thông, độ trễ và hiệu quả điện năng trở thành nút thắt trực tiếp chi phối hiệu năng, khả năng mở rộng cũng như tổng chi phí sở hữu của hệ thống.

Ở khía cạnh triển khai, Micron nhấn mạnh SOCAMM2 là thiết kế dạng module nhằm tăng khả năng bảo trì, hỗ trợ kiến trúc máy chủ làm mát bằng chất lỏng và tạo dư địa nâng cấp dung lượng trong tương lai khi nhu cầu bộ nhớ cho AI và core compute tiếp tục tăng. Đồng thời, Micron cho biết đang phối hợp với NVIDIA để đồng thiết kế bộ nhớ phục vụ hạ tầng AI tiên tiến và phía NVIDIA cũng khẳng định việc tăng dung lượng và băng thông với mức điện năng thấp hơn so với bộ nhớ máy chủ truyền thống là yếu tố giúp thúc đẩy thế hệ CPU AI tiếp theo.

Micron nói họ đang chờ JEDEC chuẩn hóa cho SOCAMM2 và hiện đã bắt đầu giao các lô đầu tiên của SOCAMM2 256 GB, đồng thời quảng bá danh mục LPDRAM cho trung tâm dữ liệu trải dài từ 8–64 GB đến module SOCAMM2 48–256 GB.

công nghệ, khoa học, kĩ thuật, mẹo vặt, cộng đồng, thảo luận, hỏi đáp, sửa lỗi, máy tính, sự cố, camera, lỗi điện thoại, lỗi máy tính#Micron #trình #làng #module #LPDRAM #SOCAMM2 #256GB #dành #cho #data #center #đang #chờ #JEDEC #chuẩn #hóa1772819912